こんにちは

今日はSamsung Galaxy S25 Ultraの簡単なインプレを書いてみたいと思います。

比較対象は良くないですが、Google Pixel9です。(^_^;

最初に思ったのは画面が綺麗!大きい!重い!

持った感じ、かなりずっしり感じます。Pixel9が198gに対して、Galaxy S25 Ultraは218gで+20g。。しかないの?持ち比べると重く感じますが、よくよく持ち比べてみると大差ない?

サイズの違いからくる間隔なんでしょうね。気の所為レベルの重量差ですね。

Google Pixel 10 Pro XLが232gなので、Galaxyは頑張ってる気がします。

画面の綺麗さはGalaxy S25 Ultraがパット見で分かるぐらい綺麗です。

Pixel 9と比べるのがおかしいですが。。

使ってみましたが、そもそも同じAndroidなので基本的な所には大きな差がない気がします。

一番大きい?と思ったのが、Galaxy S25 Ultraには通話素リーニング機能がありません。

その代わりに文字起こしや、通話録音や、リアルタイム翻訳などがあります。翻訳はPixelにもある?

使って分かりますが、Galaxy S25 Ultraの方が動作が早いです。アニメーション表示をPixelではOFFしてましたが、Galaxy S25 Ultraでは不要かも?

Pixel9も遅いとは感じませんが、Galaxy S25 Ultraの方が早いですね。ただSOCの処理速度の2倍以上。。は感じませんね。若干早いかな?ぐらいに感じます。

画面描画なども早いですが、通信がネックになるので動作全体では、そこまですげー!と言う程でも無い感じですが、早いのは早いです。

全体的に、Google Pixelは素のAndroidで、Galaxy S25 UltraはSamsungのカスタマイズが入っています。Pixel標準で出来なかった事が、Galaxy S25 Ultraではできる事も多いです。

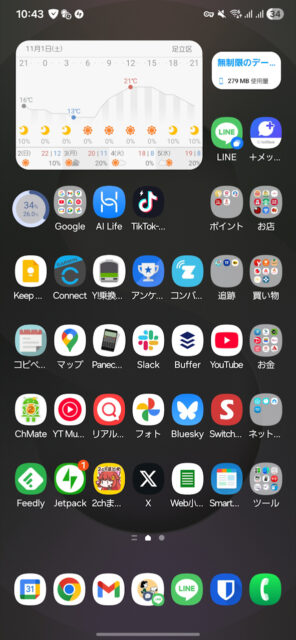

ホームアプリは、私はアイコンがたくさん置けないと嫌なんですが、Pixelランチャーはあまりおけないので、殆ど使う事なくサードパーティ製のに変更していました。その前のXperiaでもそうでした。Galaxy S25 Ultraも同じかぁ。。と思いましたが、Samsungが作っている別アプリでそのあたりは細かく変更できました。

設定メニューの並びや表示・非表示まで変更できるのにはびっくりでした。

アイコン沢山おけました(笑)

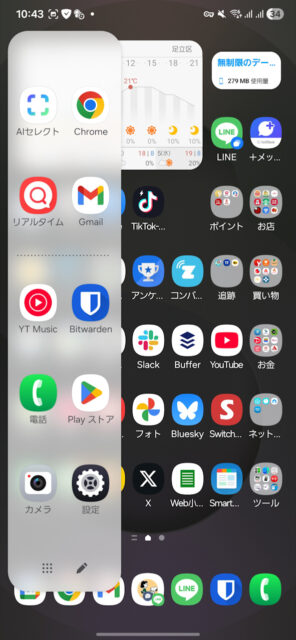

標準のラチャーですが、サイドからメニューが出せます、結構便利です。

上からスライドさせて表示させるメニューは左上からは通知、右上からはメニュー?が出ますが、混ぜる事ができました。なにげに便利です。

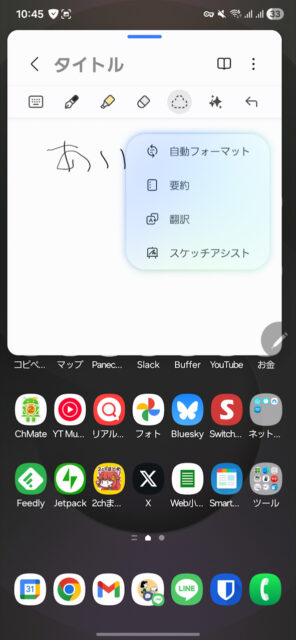

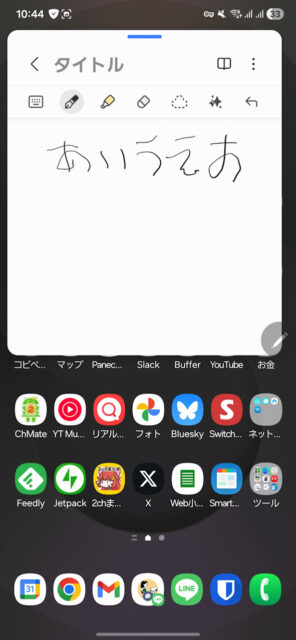

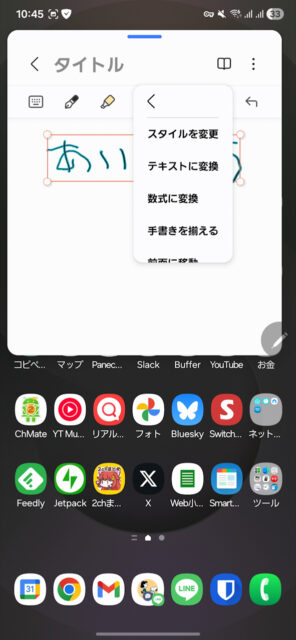

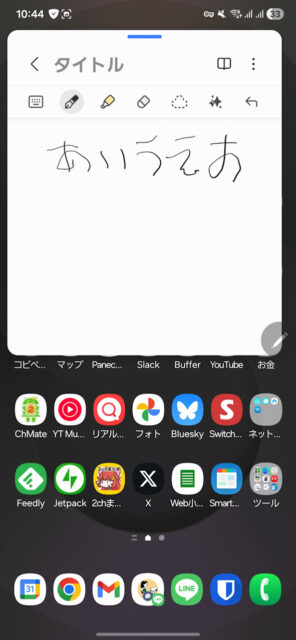

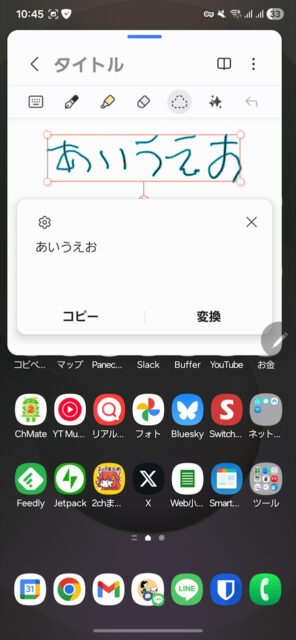

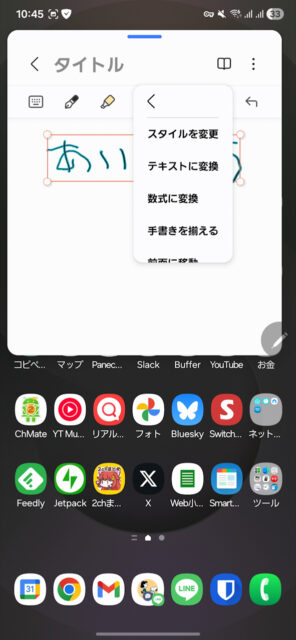

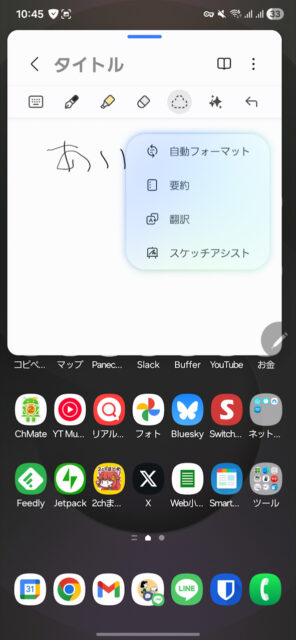

あと、Sペンというペンが内蔵されていて、手書きや手書き文字をOCRしたり出来ます。あと幼駒したりできる様です。

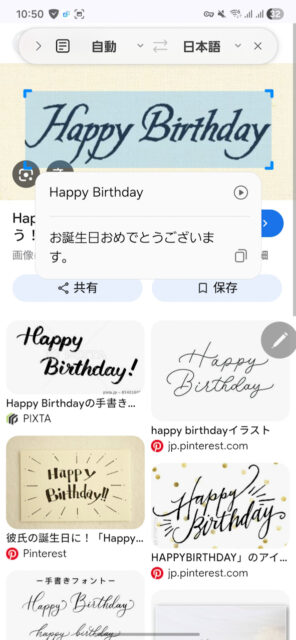

あと、画像から直接翻訳できるのは便利かも。。

あと、画面上から直接画像を抜き出して、手書きしたり。。

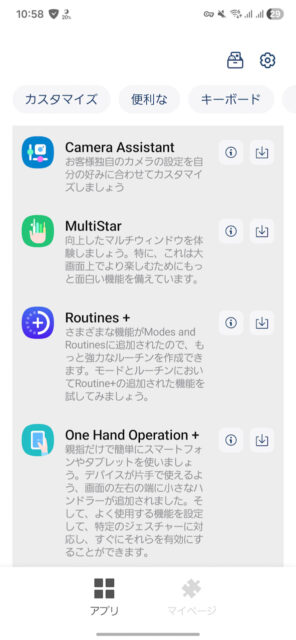

標準機能のカスタマイズはGood Lockってアプリから色々インストール出来ました。

あと、写真ですが標準が2億画素とか意味わからんぐらいの高解像度ですが。。。

レンズが所詮スマホなので、活かせてない気がします。トリミング?デジタルズーム時に有利なのかな?

ちょっと撮ってみました。家の中が写ってると不味いのでモザイクしてあります。

写真はすべて無補正(縮小のみ)です。

超広角で、富士山が見えてます。

ズームしていきます。

更に。。

100倍。薄暗くなっているのでディテールが。。。(^_^;)

撮れるだけでも良いですね。

あと、夜にスカイツリーを撮ってみました。

夜はGoogle Pixelの方がえ良い気がします。AI補正の差ですかね。。

東京タワーとか。

だいぶん前にとったGooglePixelの写真。すごいなと思いました。

Samsung Galaxy S25 Ultraだと月が撮れると見たので、100倍ズーム手持ちで撮ってみました。

少しぼやけてますが、それなりの撮れました。これもすごいな。。

色々撮って見ようと思います。

唯一思うのは、Google PixelだとGoogleアカウントだけを気にすれば良かったですが、Galaxy S25 Ultraだと、Galaxy Storeにしか無いアプリがあり、Play Storeと両方で同じアプリがあり、少しややこしいです。Huaweiのイヤホンを使っているので、Huaweiのストアもあって。。ややこしいです(^_^;

あと、指紋認証は、GooglePixelの方が良い気がします。

世界シャアが大きいSamsungのカスタムOS、慣れればかなり使いやすいですね。

純正ホームアプリって初めて使ってます。文句ないです。

コメント

100倍ズーム面白そうですね。Pixel9Proの30倍でも山から洋上の船が見えるとか結構感動したので、見てみたい世界です。動画での連続ズームでのレンズ切り替え時の色ムラとかも是非試してみてください。

ほかは、オンデバイスAIの優劣が一番気になるところかもしれません。ブレーンストーミングのときに自由に話して纏めさせたり、その場でちょっとしたアプリを作るときに、どこまで精度を上げられるか…日本を遥かに凌駕する韓国のAI技術の粋が見たいところです。

たかにぃさん

コメントありがとうございます。100倍ズームできるだけすごいですが、デジタルズームって感じて中央部分の拡大に見えます。

30倍とかでやめとけばいい感じです。Pixel9は2倍で悲しんだので幸せになれそうです。

動画は20倍までのようです。

今度、動画でズームしてみますね。レンズ切替時にズーム画とやりますが、色ムラとか出るんですね。今度やってみます。色ムラよりフォーカスがどうなんだろう?って感じがします。

AIどうなんでしょう?恩恵にかなりあずかってそうですが、意図して使ってないので良く分かんないです(^_^;

Pixelも多分そうですが、スマホ内で完結して外部に送信しないオプションがありました、学習データどうなってるんでしょうか。。(^_^;

日本はこの分野ダメそうですね。投資できなさそうですもん(^_^;

Pixel9Proで動画でズーム倍率変更すると、レンズが切り替わると青っぽかったのがいきなりアンバーがかるとか色味が変わるのがホント気になります。ぜひGalaxyで試してみてください。

LLMとかの学習済みモデルは、基本、学習データいりません。

イメージで話すと、パラメータを導くためのモデル学習にはとんでもないスペックが必要ですが、出来上がったパラメータに基づいて分類・判断を行うAIはそこそこのテンソル計算できるスペック(それでもスマホとしては高い)があれば動くわけです。再学習も微調整程度です。

現行のメジャーなクラウドLLMも欧州が情報漏洩に神経質なので、学習に用いたデータすべての要約を提示しなければならなく、再学習禁止の選択を必ずつけるルールがあります。

たかにぃさん

コメントありがとうございます。

ズームするとそうなるんですね。

良く考えると、画角内の状況が変わったらAEの調整が走りそうなので、早いか遅いかの差がありそうですが、普通に折り返すなりそうな気がします。

状況によらす発生するなら残念ですね。

試してみようかなと思ってます。

AIは全くな不勉強です(^_^;

調べたら以外と小さく、スマホでもローカルで動くレベルなんですね。

ネット上に駄文を上げてる側から考えるとインターネット上からの学習データーって、信頼性的にどうなんだろう?と、気になります。その辺りの精査も学習何なんでしょうけど。。

最近はグーグルが検索結果にAIが情報を出してるからか、めっきりアクセスが減りました。使う側からすると便利なんですが。。(^_^;

今のAIは、インターネット上のデータを学習には使わないですね。

2016年にマイクロソフトTayが公開から16時間でヘイト発言を繰り返して停止させられたこともあり、勝手に学習させるとAIは馬鹿になるので、ChatCPTやGemini、Copilotなどは人間が正解・不正解を明確にした厳選データで学習を終えてから公開されています。

Google AI検索も、ロボット検索の単なる発展型で要約の見せ方をユーザーの望むものに近づけているだけです。個別サイトが広告露出で稼ぐビジネスモデルは崩壊しますが…

たかにぃさん

お返事ありがとうございます。

ええ。。インターネットの情報を使わないんですか。広く情報を取得するの大変ですね。

広く学習させる為の情報元に興味津々です。

精査はやはり人間なんですね。

個人サイトもサーバ代ぐらいは回収したいですが、難しくなりそうですね。今の所は、まだ。。大丈夫ですが。。。(^_^;

端末の進化という意味ではアンドロイドスマホは魅力的ですよね。

メーカーごとの工夫も面白いですし。

私はiPhoneの魅力に抗しきれず、iPhoneで飼いならされてしまったのでもう逃げられません。

なんだかんだで端末スペックを感じさせずヌルヌル動くアップルの作りこみはすごいと思っています。

TKさん

コメントありがとうございます。

iPhoneは買い替えても、困らないのとアプリが安定してるのが良いですよね。

その代わりにカスタマイズ幅がちいさいですけど。

iPhoneってアップデートのサポート期間が長く長期間安心して使えるのがすごいです。